La escucha nunca es totalmente objetiva, precisa o abarcativa. Muchas veces, oímos en un discurso solo aquello que estamos buscando. Esa “intentio” de nuestra inquietud interior opaca otras dimensiones que pueden ser muy pero muy relevantes, pero nuestro oído interno las discrimina. Seguramente alguno de ustedes, cuando leyó “clasificatorio”, pensó en el Mundial de Futbol ¿o me equivoco?

Algo así me pasó al escuchar la semana pasada a Milagros Miceli, Dra. en Informática y socióloga, investigadora argentina que reside en Berlín y que hace poco ha sido reconocida como una de las personas más influyentes en IA por la Revista Time. Fui a su muy interesante presentación en la empresa Santex gracias a la generosa invitación de Enzo Dotto. La conferencia se titulaba “Lo que nadie te dice de la IA” y abordó diversas problemáticas como la de los trabajadores precarizados que sostienen los algoritmos, la dimensión extractiva de la creatividad humana, las personas que se hacen pasar por bots cuando el Bot no funciona (¡!!), la cuestión de la propiedad intelectual, el uso de los recursos energéticos. En particular, yo presté mi atención borgeana (ya les diré por qué) a la cuestión del etiquetado de datos.

Data Annotation

Como socióloga, Miceli introduce la dinámica de poder en su análisis del lado oscuro de la inteligencia artificial. A este poder, Miceli lo caracterizó como poder epistémico. Si bien, aun no encontré -porque no busqué exhaustivamente- si Miceli ofrece una definición particular para esta idea, podemos recordar que “epistémico” caracteriza a lo relacionado con el conocimiento, la ciencia, la comprensión y también, desde un punto de vista foucaultiano, epistémico se refiere a algo así como la base, las reglas, las condiciones de una época que posibilitan el saber.

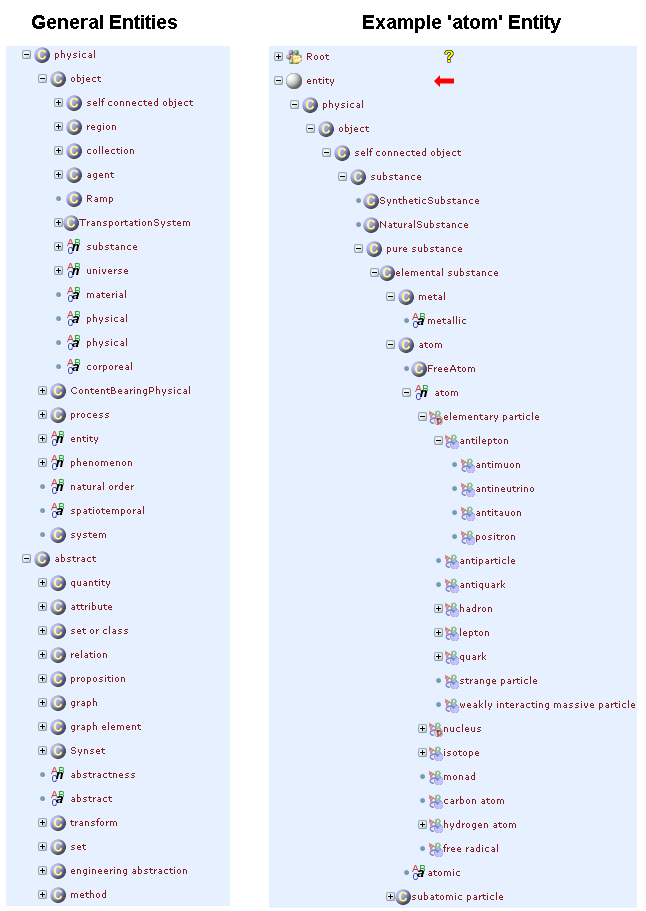

Antes de continuar preguntémosle a la IA qué es eso del etiquetado de datos. El proceso de “Data Annotation” es, según, el Modo IA de Google “(…) como enseñar a un niño, donde se le muestra un objeto y se le dice qué es (ej. “esto es un gato”) para que aprenda a reconocer patrones”. En este sentido, me animo a definir (interpretando a Miceli) que el poder epistémico de la IA es su capacitad de establecer las condiciones de posibilidad del saber de esta época -o quizás de la que sigue.

Mundos arbitrarios

Miceli, en su presentación, insistió en este hecho. Es un “facto”: se clasifica de un modo impuesto y listo. El empleado de la empresa tecnológica aplica una grilla de clasificación que le viene “de arriba” y, por contrato, no puede cuestionar la grilla. Esa grilla tiene criterios ideológicos, según dijo Miceli, por lo que se convierte en un proceso que puede servir para imponer ideas o verdades difíciles de cuestionar.

Sí encontré -en un paper de su autoría- en el que Miceli dice: “Analizar las prácticas clasificatorias y su relación con el poder es vital para entender cómo las cuestiones sociales y técnicas se relacionan intrínsecamente entre sí cuando se trata de resultados sesgados (biased outcomes). Las clasificaciones tienen el poder de imponer una (di)visión arbitraria (arbitrary (di)vision) del mundo sobre otros. Tanto en los ámbitos técnicos como sociales, las clasificaciones son usadas para agrupar y etiquetar (to cluster and label) realidades variadas (varied realities) de modo tal que puedan ser mejor captadas (grasped) como una unidad medible homogénea” (Kazimzade & Miceli, 2020) ( Traducción propia, sin IA)

Borges y las clasificaciones

Mencioné al comienzo mi oído borgeano, porque desde hace un tiempo que estoy investigando qué diría Jorge Luis Borges de la IA. Baste en esta breve nota, recordar que Borges ironizó reiteradamente sobre los intentos clasificatorios humanos y subrayó con la belleza del lenguaje tanto la arrogancia como los balbuceos de las enciclopedias, de las bibliotecas babelianas, de los idiomas analíticos, de los Carlos Argentino Daneri que pretenden en un solo texto incluir todos los seres contenidos en la infinitud del ojo del Aleph.

Mantendré mi oído atento y continuaré con las lecturas. Estas preguntas recién comienzan.

Si cada sistema de clasificación —ya sea humano, algorítmico o enciclopédico— inevitablemente impone una visión arbitraria del mundo, ¿cómo podemos distinguir entre una clasificación que nos permite comprender mejor la realidad y otra que, bajo la apariencia de neutralidad, redefine silenciosamente aquello que somos capaces de percibir, pensar y saber?

Alejandro, te respondí en LinkedIn